计算机视觉 图像形成计算机视觉将人类有可能完成的任务自动化,你知道吗?

计算机视觉是一个研究领域,旨在推动计算机使用复杂算法(可以是传统算法,也可以是基于深度学习的算法)来理解数字图像和视频并提取有用的信息。

什么是计算机视觉?

计算机视觉的主要目标是,先理解视频和静止图像的内容,然后从中搜集有用的信息,以便解决越来越多的难题。作为人工智能(AI)和深度学习的子领域,计算机听觉可练习卷积神经网络(CNN),以便对于各类应用场合开发仿人类视觉功能。计算机视觉包含对CNN进行特定训练,以便运用图像和视频进行数据分割、分类和测试。

卷积神经网络(CNN)无法对于多种应用场合执行分割、分类和测试:

分割、分类和评估

分割

分类

检测

特别适合用于描述对象

是猫还是狗?

它存在于空间中的哪些位置?

在手动驾驶车辆中使用

精确分类

识别关乎安全的事物

计算机视觉为何重要?

在体育、汽车、农业、零售、银行、施工和保险等产业,计算机视觉应用十分广泛。得益于现在机器用于鉴别物体的图象处理器–卷积神经网络(CNN),各种由AI驱动的机器纷纷开始采取仿人眼科技来获取更多助力。CNN已变成现今自动驾驶车辆、石油勘探和聚变能源研究领域的“眼睛”。它们也有助于在医学成像领域迅速看到疾病并拯救生命。

数十年来计算机视觉 图像形成,传统的计算机视觉和图像处理科技尚未应用于很多应用和研究工作。然而,现代AI科技运用人工神经网络,能够推动更高的性能准确性;高性能计算依托GPU取得长足进步,实现超人的精确性,从而在物流、零售、制造、医疗健康和金融服务等产业广泛应用。

在将图像和视频分类为精细离散的类型和分类方面,如同医学计算机轴向断层扫描或CAT扫描中随时间推移而形成的微小差异,传统或基于AI的计算机视觉系统远胜于人类。在这个含义上,计算机视觉将人类有也许完成的任务自动化,但其具体性和速度要高得多。

当前和潜在的应用多种多样,因此计算机视觉科技和缓解方案的下降分析比较惊人,这点不足为奇。一项市场调研表明,到2023年,该市场将以惊人的47%的年下降率下滑,届时将在中国超过250亿港元。在整个计算机科学范畴内,计算机视觉是热门、活跃的开发领域之一。

计算机视觉的工作原理是哪个?

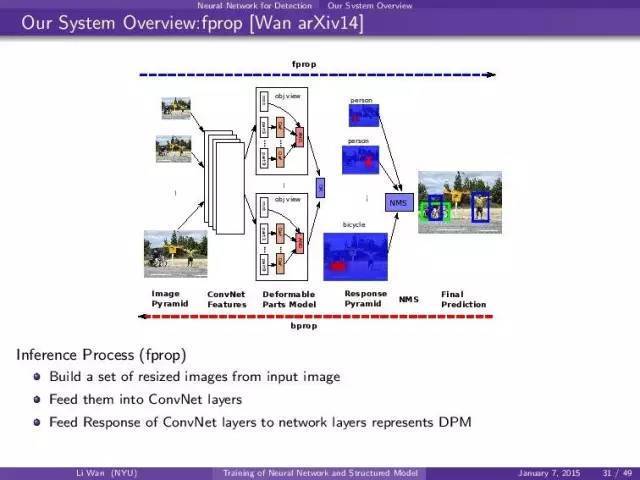

计算机视觉分析图像,然后使用聚类神经网络(CNN)构建其“所见”的数值表示。CNN是一类人工神经网络,使用聚类层从输入中筛选出有用信息。卷积运算必须综合使用输入数据(特点图)与频域内核(插值器),以便生成转换后的特点图。卷积层滤波器可依据学习参数进行更改,以便为特定任务提取最有用的信息。卷积网络可依照任务自动调整,寻找最重要的特点。在执行通常的物体识别任务时,CNN会过滤物体的颜色信息;但在进行识别鸟的任务时,CNN则会提取鸟的形状信息。这是鉴于CNN认为,不同类的物体会具有不同的外形,而针对不同种类的鸟而言计算机视觉 图像形成,其色彩或许要比颜色的差别性更大。

计算机视觉的产业用例

计算机视觉用例包含图像辨识、图像分类、视频标记和虚拟助手。计算机视觉领域中非常流行和突显的用例包含:

数据科学家和计算机视觉

Python是机器学习(ML)领域的热门编程语言,许多数据科学家都熟悉其易用性以及小型库(其中大多数库都是免费和开源的)。数据科学家在ML系统中使用Python进行数据挖掘和数据预测,因为Python支持各类ML模型和算法。鉴于ML和计算机视觉之间的关系,数据科学家可以运用计算机视觉应用向各种企业的扩展,从图像和视频传输中提取重要信息,增强数据驱动的决策建立。

借助GPU加速卷积神经网络

在架构方面,CPU仅由几个具备大缓存存储的核心构成,一次只可以处理几个工具线程。相比之下,GPU由数百个核心构成,可以同时处理数千个线程。

因为神经网络由长期相同的神经元推进而成,因此本质上带有高度并行性。这种并行性自然地会映射到GPU,能够提供数据并行的算术架构,并且相比仅限CPU的锻炼,计算速率持续下降。这类型型的架构对一系列图像数据执行类似的推导。GPU的单指令多数据(SIMD)功能使其适合运行计算机视觉任务,这些任务一般涉及对整个图像进行类似的计算。具体而言,NVIDIAGPU可明显加速计算机视觉操作,为其它工作释放CPU。此外,在同一台机器上可以使用多个GPU,创建能够并行运行多个计算机视觉算法的架构。

NVIDIAGPU加速的深度学习框架

GPU加速深度学习框架为Python等常见编程语言提供编程接口。其还具有轻松建立和构建自定义CNN和DNN的灵活性,同时还能推动实验和工业部署所需的超高速度。NVIDIACUDA-XAI能够加强Caffe、MicrosoftCognitiveToolkit(CNTK)、TensorFlow、Theano和Torch等广泛使用的深度学习框架并且很多其它机器学习应用的运行速率。深度学习框架在GPU上的运行速率更快,并可以在单节点内的多个GPU间扩展。要将框架与GPU一起用于卷积神经网络的练习和推理过程,NVIDIA分别提供cuDNN和TensorRT™。cuDNN和TensorRT可为卷积层、池化层、归一化和激活层等标准实例实现高度调整。

单击此处查看NVCaffe安装方法和使用指南。可在这里找到卷积神经网络C++/CUDA快速实施。

为迅速研发和推进视觉模型,NVIDIA向视觉AI开发者提供DeepStreamSDK。其中包括TAO工具包,可用于为计算机视觉领域建立准确高效的AI模型。

NVIDIAGPU加速的端到端数据科学

制定在CUDA基础上的NVIDIARAPIDS™开源工具库套件使您就能完全在GPU上执行端到端数据科学和预测流程,同时依然使用Pandas和Scikit-LearnAPI等熟悉的界面。

转载原创文章请注明,转载自设计培训_平面设计_品牌设计_美工学习_视觉设计_小白UI设计师,原文地址:http://zfbbb.com/?id=5043